Può un algoritmo basato su dati statistici avere dei pregiudizi razziali? Questo è quello che ci si chiede venendo a conoscenza della storia di Robert Julian-Borchak Williams. Un uomo di colore condannato al carcere da uno strumento di riconoscimento facciale utilizzato dalla polizia di Detroit nel corso di un’indagine su un furto in un negozio di lusso.

Stando a quanto riporta il New York Times, nel gennaio scorso, Williams riceve una telefonata da parte della polizia. Viene intimato di recarsi alla stazione di Detroit per venire arrestato. L’accusa è di aver rubato degli orologi nel negozio di lusso Shinola nell’ottobre 2018, per un totale di 3.800 dollari. Inizialmente, l’uomo pensa si tratti di uno scherzo e ignora la richiesta. Finchè le forze dell’ordine non lo raggiungono a casa sua, dove lo arrestano sotto gli occhi sconcertati di moglie e figlie.

Gli agenti si sono affidati solo all’algoritmo

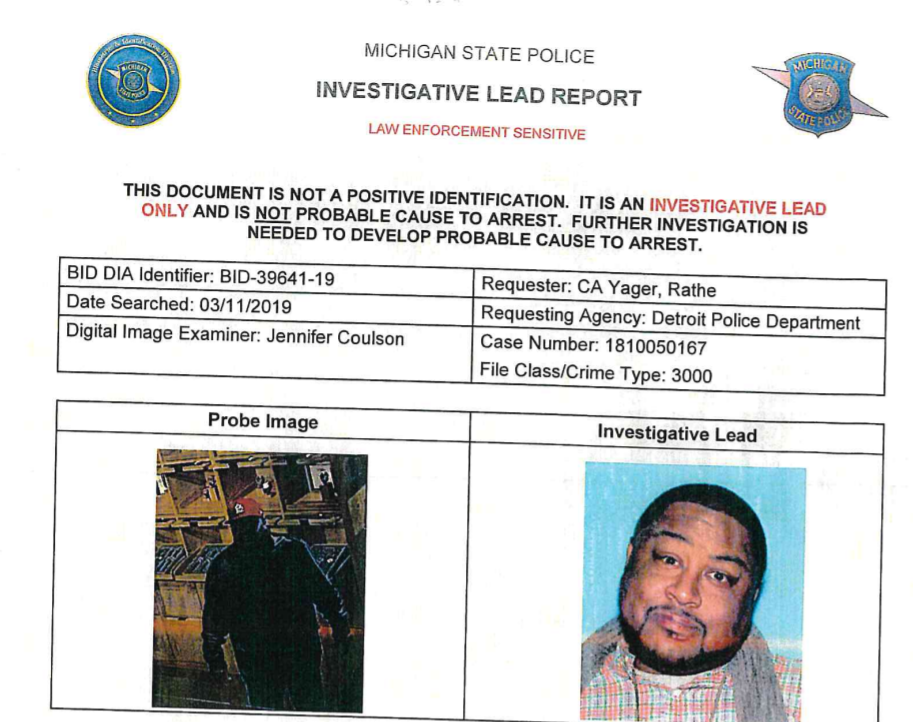

Il giorno del furto il negozio aveva inviato le riprese della videocamera di sicurezza a un investigatore privato. Egli, dopo aver selezionato alcune immagini, le aveva spedite alla polizia di Detroit. Cinque mesi dopo, la persona incaricata ad esaminare le immagini digitali ha inserito un'”immagine probante” nel database. L’algoritmo ha, così, iniziato la ricerca di match nel suo archivio di 49 milioni di immagini. Trovata la corrispondenza con la foto della patente di Williams, il gioco è fatto. Gli agenti, invece di cercare altre prove a conferma di questo indizio, si affidano ciecamente e unicamente al computer.

Computer che, evidentemente, compie un errore di valutazione. Infatti, quando nella sala degli interrogatori Williams affianca i fotogrammi al suo volto, è chiaro che si tratti di due persone diverse. Un errore che è costato all’accusato 30 ore di prigione e mille dollari di cauzione.

L’inaccuratezza di questi sistemi

Da tempo questi algoritmi sono visti con scetticismo e occhio critico. Da una parte si pensa che l’uso sempre più massivo determini un’erosione della privacy. Dall’altra viene criticata la scarsa precisione dei loro risultati. Nel caso di Williams, questi limiti hanno portato a un ribaltamento dei fondamenti giuridici, passando dalla presunzione d’innocenza alla presunzione di consapevolezza.

Il software utilizzato dalla polizia di Detroit si appoggiava a due algoritmi giapponesi che erano stati sottoposti nel 2019 a un test sull’affidabilità dei risultati. Lo studio ha dimostrato un calo da 10 a 100 volte dell’accuratezza del riconoscimento facciale quando si tratta di volti afroamericani o asiatici rispetto a quelli caucasici. Questo perchè le immagini d’archivio sono composte principalmente da volti di uomini bianchi. I risultati hanno dimostrato una scarsa attendibilità anche per quanto riguarda il riconoscimento di volti femminili, per lo stesso motivo.

Il vero problema è nella società

Per rispondere alla domanda posta all’inizio dell’articolo, ovviamente i meccanismi di deep learning alla base del riconoscimento facciale non sono stati progettati per avere pregiudizi di alcun tipo, tantomeno razziali. La base del problema sta piuttosto nella nostra società, spesso inconsapevolmente e intrinsecamente razzista. Come ha affermato Alexandria Ocasio-Cortez, nuova paladina della sinistra americana:

“Le tecnologie di riconoscimento facciale portano con sè iniquità razziali perchè gli algoritmi sono pur sempre fatti dagli uomini. Se non risolviamo questi preconcetti alla base, finiremo per automatizzarli.”

Leggi anche:

Quarta Rivoluzione Industriale e Tech Gleba senza alternative

Elzeviro Informazione indipendente

Elzeviro Informazione indipendente